私たちは、テクノロジーの進歩が人々の生活を豊かにし、創造性を広げ、世界をより良くするものだと信じて疑いませんでした。しかし、今、その技術がかつてないほどダークな側面を露呈しつつあります。2025年の今、AIは新たな犯罪の温床として、子どもたちの尊厳と安全を脅かすツールへと変貌を遂げています。

ニューヨーク・タイムズが7月10日に発表したレポートによると、AIによって生成された児童性的搾取マテリアル(CSAM:Child Sexual Abuse Material)が急増しており、そのリアリティは、もはや人の目では真偽の判別が困難なレベルに達しています。

もはや現実と区別不能。AI生成CSAMの恐るべき“進化”

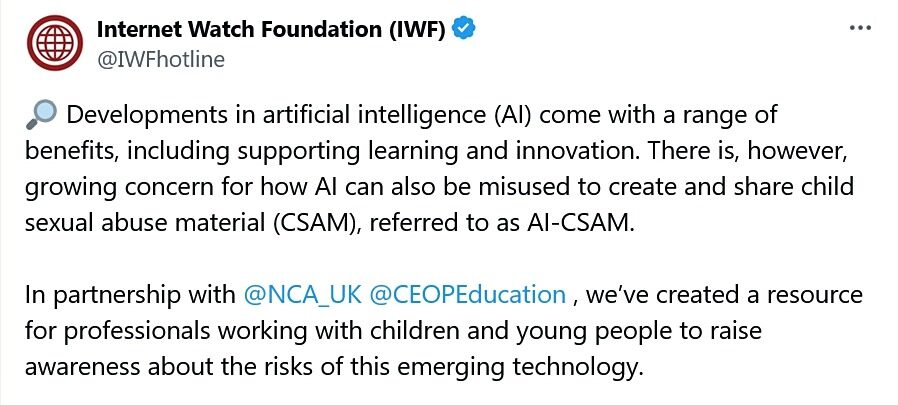

インターネット観察財団(IWF)とアメリカ失踪・搾取児童国家センター(NCMEC)は、2025年上半期の調査で、極めて精巧に作られたAI生成CSAMの事例が1286件確認されたと報告しました。これは、わずか1年前の2024年上半期におけるわずか2件という数字と比較すると、天文学的な増加です。

この数字が意味するのは単なる“多さ”ではありません。それは、AIがもはや違法コンテンツの“製造機”として機能し始めており、しかもその“作品”は、本物と遜色のないリアリズムを持って流通しているという冷厳な事実です。

NCMECはさらに、今年上半期に485,000件のAI生成CSAMに関する通報を受け取ったと発表しました。前年(2024年)の年間総数が67,000件だったことを考えると、成長率はもはや指数関数的です。

「これは津波だ」──止められぬ波に挑む現場の悲鳴

IWFの暫定CEO、デリック・レイ=ヒル氏は、今回の報告を受けてこう語っています。

「これは明確な警告です。我々は今、本物の津波に直面しているのです。」

彼が示唆するように、この現象はもはや一過性の異常ではなく、技術の進化が引き起こした構造的・制度的な危機であることは明らかです。

しかもこれらのコンテンツは、主にダークウェブで流通しており、捜査機関による追跡は困難を極めています。匿名性が高く、取引の証拠も暗号化されているため、摘発や法的対応が極めて難しいのです。

AIは何を学んでいるのか? ――“素材”にされた子どもたち

最も恐ろしい点は、これらのAI生成コンテンツが、実在の子どもたちの画像や動画を学習素材として使用している可能性があることです。ニューヨーク・タイムズによれば、学校のウェブサイトやSNSなど、一般に公開されている子どもの写真が無断でAIの訓練データとして使われているケースも確認されています。

つまり、私たちが日々SNSに投稿する“何気ない我が子の笑顔”が、犯罪者たちの手によって悪意のあるコンテンツへと変貌させられているのです。これ以上の背筋の凍る現実があるでしょうか?

なぜここまで放置されたのか? 社会とプラットフォームの責任

では、なぜこれほどまでの深刻な事態が、社会の目から隠されてきたのでしょうか?

それは、AIという技術の進化スピードが法律や倫理の整備を凌駕しているからに他なりません。AI画像生成ツールの多くは、生成の際に使われたトレーニングデータの出所を明示せず、またユーザーによる利用目的も制御不能です。

大手プラットフォームの中には、コンテンツの検閲やAI画像のスクリーニングに取り組む動きも見られますが、その技術と実装は依然として不完全であり、実効性に乏しい状況が続いています。

未来を守るために。今、私たちが問われていること

この問題は単に「技術の誤用」という一言で片付けることはできません。それは、**社会の無関心と法制度の遅れ、そしてプラットフォームの責任放棄が絡み合った“構造的犯罪”**です。

だからこそ、私たち一人ひとりが、「子どもの写真をネットに投稿する」という行為の重さを再認識する必要があります。そして、政府や企業に対しても、より強力かつ透明性の高い対応策を求めていくべきです。

AIの進化は止められません。であれば、我々が問うべきは「止めるべきか」ではなく、「どう制御するのか」ということです。

結びに

この記事で紹介した現実は、目を背けたくなるほど残酷で、私たちが想像している以上に深く広がっています。しかし、事実を知ることこそが、対策の第一歩です。

誰かの無邪気な笑顔が、知らぬ間にAIによって“商品化”されてしまう未来など、あってはなりません。今この瞬間も、ネットの片隅では、新たなコンテンツが生成され、共有されているかもしれません。

この“闇”にどう立ち向かうか。問いは、私たちすべてに向けられています。