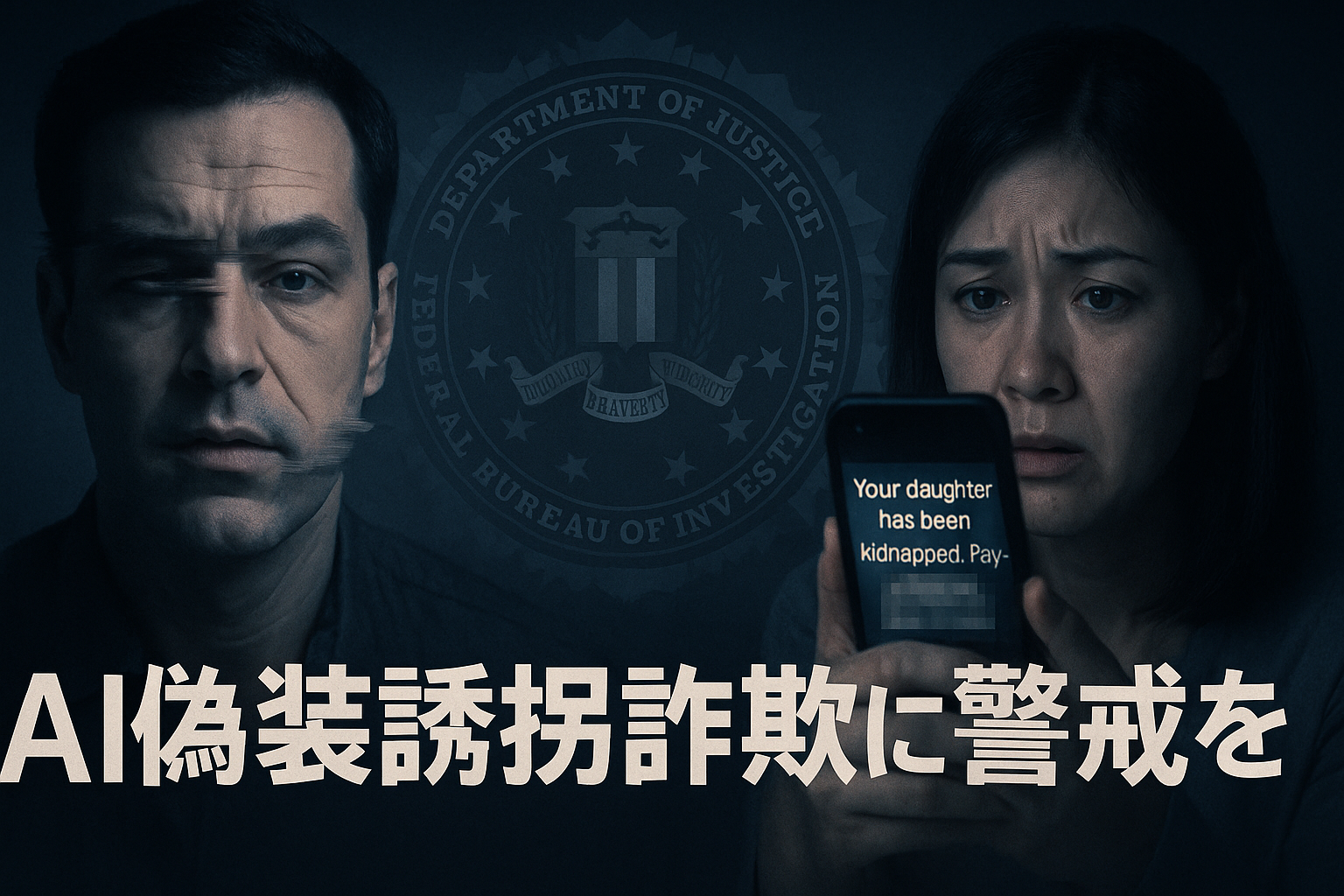

アメリカ連邦捜査局(FBI)は2025年12月、新たなネット詐欺の手口に対する注意喚起を発表しました。その内容は、生成AIを使って誘拐されたかのように見せかけた偽の映像を作成し、家族から身代金を騙し取るというものです。

この手法は、いわゆる「ディープフェイク(deepfake)」技術を悪用したもの。犯罪者はターゲットとなる人物やその家族の写真・動画・音声といった公開情報をインターネット上から収集し、それをもとにリアルに再現された“人質映像”をAIで生成します。

例えば、ある人が椅子に縛られ、「助けて」と泣き叫んでいる映像。本人にそっくりな顔、声、表情、動き。これが生成AIによって自動的に合成されることで、まるで実際に誘拐されたかのような錯覚を引き起こすのです。

このような映像を受け取った家族は当然、本人の安否を案じ、冷静な判断が難しくなります。犯人はそこに付け込んで、「今すぐ金を払わなければ命はない」などと脅迫し、短時間で身代金の支払いを強要してきます。

特に巧妙なのが、送信手段に「自動消去型の通信アプリ」を使う点です。受け取った動画や音声は一定時間が経つと消えてしまい、保存や共有ができない仕組みになっていることが多いとのこと。これにより、家族は映像の真偽を誰かに相談することも難しく、急いで対応しなければと錯覚しやすい心理状態に追い込まれるのです。

FBIはこうした手口がここ最近で急速に広まりを見せていると警告しています。特に、AIによる映像生成技術の進化スピードが予想以上に速く、今では素人目にはほとんど本物と見分けがつかないほどのクオリティになっていると指摘。今後、さらに被害が拡大する恐れもあるとのことです。

それでも、完全に騙しきれるわけではないとFBIは言います。生成AIによる動画には、今なお細かい不自然さや違和感が残ることがあるそうです。

たとえば、

-

顔の動きが不自然に滑らかすぎる

-

まばたきの頻度が異常に少ない

-

体の動きと顔のタイミングが微妙にズレている

-

被害者特有の外見的特徴(ホクロ、タトゥー、傷跡など)が再現されていない

といった点が挙げられます。これらの特徴に気づけば、「これはAIで作られた偽物ではないか」と冷静に疑うきっかけになるかもしれません。

このような事態を防ぐため、FBIは一般の人々が普段から気をつけておくべき対策として、以下のような具体的なアドバイスを発表しています。

まず第一に、インターネット上に自分や家族の写真・動画を過度に公開しないこと。とくに、顔がはっきり映った動画や長時間の会話音声などは、AIにとって合成素材として非常に使いやすいため注意が必要です。

次に、SNSのプライバシー設定を見直すこと。信頼できる知人以外には自分の投稿が見えないよう制限を設けるだけでも、素材の流出リスクを大きく減らせます。

さらに、旅行中など、長時間家族と連絡が取りにくい時期には特に注意が必要です。犯人は、こうしたタイミングを見計らって家族に連絡を取ってきます。「今、本人に確認が取れない」という状況こそが、犯人にとって“最大のチャンス”なのです。

そして、万が一身代金を要求するメッセージや映像を受け取ったとしても、即座に振り込まず、必ず本人に直接連絡を取って安否を確認すること。連絡がつかない場合は、必ず警察などの専門機関に相談することが重要です。

ディープフェイクは、もともと映画やエンターテインメントの分野で注目された技術ですが、その裏ではこのように人の善意や不安につけ込む犯罪にも転用されているのが現実です。

FBIは、こうした犯罪がこれからも高度化していくことを見据え、市民一人ひとりが「疑う目」を持ち、冷静な判断力を養うことが求められていると強く訴えています。